Analógico y digital ¿Cómo se mete la naturaleza en una computadora?

Por el Lic. Ignacio Bruvera

Para estudiar y manipular nuestro entorno, los humanos hemos desarrollado una gran cantidad de dispositivos. Algunos se encargan de transformar las magnitudes de la naturaleza (intensidad luminosa, presión, temperatura, humedad, etc.) en otras magnitudes que podemos fácilmente cuantificar (o sea, expresar numéricamente) . Una vez hecha la cuantificación, basta comparar con alguna referencia o patrón predeterminado para efectuar lo que llamamos Medición. Las mediciones son la base fundamental de la ciencia y los instrumentos que nos permiten realizarlas son llamados Sensores.

También existen los dispositivos que nos permiten recorrer el camino inverso, provocar variaciones en alguna magnitud de la naturaleza a partir de señales generadas por nosotros. Ejemplos cotidianos de estos últimos son los equipos de audio que transforman señales eléctricas en acústicas (variaciones en la presión del aire) o los de video que generan imágenes (variaciones en la intensidad luminosa).

Volviendo a los sensores, inicialmente estos traducían las cantidades medidas en la posición espacial de un indicador sobre una escala gráfica (una aguja sobre una regla) (Fig. 1).

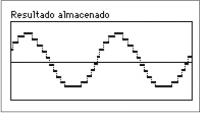

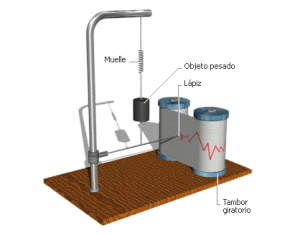

Este mecanismo funciona muy bien, pero no es muy práctico a la hora de visualizar la evolución de la cantidad medida, ya sea temporal o respecto a cualquier otra magnitud. Para lograr esto las opciones son, anotar los valores sucesivos indicados por la aguja al mismo tiempo que los de la otra magnitud (por ejemplo valores de tiempo) para luego aparearlos en una tabla o gráfico, o mover la escala debajo de una aguja entintada como lo hacen los sismógrafos y los electrocardiógrafos (Fig. 2). Pero esto, a veces, no es suficiente.

Con el advenimiento de la electricidad empezamos a contar no sólo con una excelente forma de transportar, manipular, almacenar y transformar la energía utilizada para nuestras tareas cotidianas sino también con una nueva manera de hacer lo propio con la información. Ya sea mediante cables o de forma inalámbrica, la capacidad de generar y detectar variaciones temporales en los campos eléctricos y magnéticos (ondas electromagnéticas) es la piedra fundamental para el paso de la era industrial a la era de la información. Así es que surgió toda una nueva gama de dispositivos basados en fenómenos electromagnéticos, tanto para explorar la naturaleza como para modificarla.

Si bien aún antes de la proliferación de dispositivos eléctricos existieron desarrollos tecnológicos que se pueden considerar los precursores de la computación actual, la explosión de la informática basada en máquinas electrónicas durante el sXX significó un enorme avance en la manera en la que almacenamos y procesamos la información. Si bien existen computadoras analógicas, la enorme mayoría de la información actual se procesa mediante dispositivos digitales. Esto obliga a que la información misma sea digital durante su tratamiento por lo que cabe preguntarse en qué consiste lo digital.

Analógico y digital

“Digital” es una palabra que aparece relacionada a la enorme mayoría de la tecnología actual. Intuitivamente la entendemos como sinónimo de moderno o preciso, pero ¿qué significa exactamente que un dispositivo sea digital?.

Las señales en general, entendidas como variaciones temporales de alguna cantidad mediante las cuales se transmite información, pueden ser analógicas o digitales.

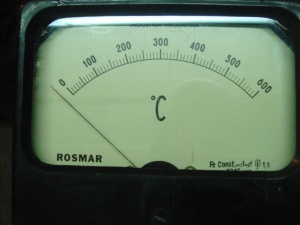

Las señales analógicas son continuas temporalmente y pueden tomar cualquier valor de amplitud dentro de su rango de manifestación. Por otro lado, las señales digitales se transmiten de forma intermitente (aunque regular) y su espectro de valores posibles está “cuantizado”, esto es, dados dos valores permitidos (típicamente estos valores están equiespaciados), la señal no puede tomar ningún valor intermedio. Como veremos más adelante esto facilita mucho su manipulación y almacenamiento. El inconveniente radica en que la gran mayoría de las señales del mundo físico se nos presentan como analógicas por lo que es necesario transformarlas para poder introducir la información que portan, en los sistemas informáticos.

2.1.El conversor analógico digital El Conversor Analógico/Digital (A/D) es el corazón de cualquier dispositivo digital ya que se encarga de transformar la información permitiendo su transferencia entre el sistema informático y el mundo exterior.

Como su nombre lo indica el conversor A/D es un dispositivo que convierte una señal eléctrica continua en una señal digital discreta y cuantizada. Este proceso se realiza en tres pasos básicos:

• Muestreo: Las señales digitales son discretas (intermitentes) en el tiempo mientras que las analógicas son continuas, por lo tanto es necesario para la conversión A/D muestrear la señal original. Esto significa que el conversor no está “mirando” continuamente la información que le llega sino que toma nota de los valores a intervalos regulares de tiempo (Fig. 3).

Se puede demostrar rigurosamente que, si la frecuencia de muestreo fM (la cantidad de veces por segundo que el conversor mide la señal de entrada) es mayor al doble del

ancho de banda (diferencia entre la mayor y la menor de las frecuencias componentes) de la señal original el proceso de muestreo es reversible y, por lo tanto, esta se puede recuperar sin pérdida a partir de la señal muestreada. Esta condición se llama Criterio de Nyquist y su demostración formal constituye el Teorema de Nyquist-Shannon. Una forma más intuitiva de ver esto es analizando el fenómeno de Aliasing.

Supongamos que queremos determinar la posición de la menor aguja de un reloj usando las horas como coordenadas. Como todos sabemos, la frecuencia de giro real es de una vuelta cada 12 horas (fR=1/12 h-1). Mirando una vez por hora (fM=1h-1=12fR) obtendríamos la tabla 1 con la cual podemos reproducir sin confusiones el movimiento de la aguja.

| t(h) | 0 | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| p(h) | 12 | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 |

Mirando cada cuatro horas (fM=1/4h-1=3fR) obtendríamos la tabla 2 a partir de la cual seguimos deduciendo un movimiento en la dirección y con la frecuencia correcta.

| t(h) | 0 | 4 | 8 | 12 | 16 | 20 | 24 | 28 | 32 | 36 | 40 |

|---|---|---|---|---|---|---|---|---|---|---|---|

| p(h) | 12 | 4 | 8 | 12 | 4 | 8 | 12 | 4 | 8 | 12 | 4 |

Ahora viene lo interesante. Si medimos cada 6 horas (fM=1/6h-1=2fR) obtenemos la tabla 3. Solo vemos una aguja que se mueve entre dos posiciones opuestas. Si bien la frecuencia sigue siendo la correcta (cada 12 horas la aguja regresa a su posición original en el 12), ya no podemos afirmar, a partir de las medidas, en qué dirección (horaria o antihoraria) se realiza el movimiento.

| t (h) | 0 | 6 | 12 | 18 | 24 | 30 | 36 | 42 | 48 | 54 | 60 |

|---|---|---|---|---|---|---|---|---|---|---|---|

| p (h) | 12 | 6 | 12 | 6 | 12 | 6 | 12 | 6 | 12 | 6 | 12 |

Como es obvio a esta altura, si muestreamos cada 12 horas (fM=fR) la aguja parece no moverse en absoluto, la veremos siempre en el 12. Pero lo más interesante es lo que pasa cuando muestreamos por debajo de la frecuencia del fenómeno. Midiendo cada 11 horas por ejemplo obtenemos la tabla 4 ¡según la cual la aguja se mueve de forma antihoraria y tarda 132 horas en dar toda la vuelta!

| t (h) | 0 | 11 | 22 | 33 | 44 | 55 | 66 | 77 | 88 | 99 | 110 |

|---|---|---|---|---|---|---|---|---|---|---|---|

| p (h) | 12 | 11 | 10 | 9 | 8 | 7 | 6 | 5 | 4 | 3 | 2 |

Este fenómeno se llama Aliasing (de Alias) y es la causa de que las ruedas se vean girando al revés cuando lo hacen a una frecuencia mayor que el muestreo del ojo (el ojo es uno de los pocos sistemas naturales que muestrea).

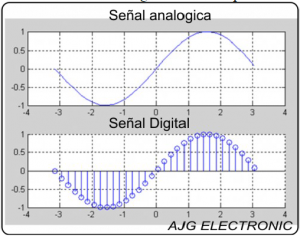

Más generalmente supongamos una señal sinusoidal de frecuencia f como la de la figura 4. Si la muestreamos a una frecuencia s<2f no la distinguiríamos de una señal de frecuencia f´=s-f. Esto se puede observar en cualquier fenómeno periódico.

Como último y más representativo ejemplo tenemos el audio digital. El ser humano es capaz de oír frecuencias sonoras en el intervalo 20Hz-20kHz (1Hz es una ciclo por segundo) lo que representa un ancho de banda de 20kHz aproximadamente. Por esta razón el muestreo de audio digital es de 44100Hz (el 44kbps que aparece en el WinAmp). Los 4100Hz extras se deben al margen de error a la hora de recuperar la señal. Las pistas de audio muestreadas a una frecuencia menor se oyen distorsionadas.

• Cuantificación: Una vez tomadas las muestras se analiza su amplitud. Como se mencionó anteriormente, una señal digital es cuantizada lo que significa que, a diferencia de la señal analógica su amplitud no puede tomar cualquier valor. Así, para cuantificar, se redondea el valor de cada una de las medidas tomadas en el muestreo. De esta manera la señal queda cuantizada ya que las muestras tendrán valores de amplitud pertenecientes a un conjunto predeterminado. Es claro que con este proceso se pierde parte de la información y que la cantidad de información perdida será inversamente proporcional a la cantidad de segmentos en los que dividamos el eje de amplitudes (Fig. 4).La cantidad de divisiones está dada por la Resolución del conversor. Esta magnitud se mide en bits si se codifica en código binario

• Codificación: Consiste en el pasaje de los datos cuantizados al código que se utilice para transmitirlos y almacenarlos. En la mayoría de los casos se utiliza código binario en donde la información se almacena en bits. Un bit es la unidad elemental de información digital y consiste en un 0 o 1 binario, de esta manera la cantidad de bits que procese el conversor informa sobre la cantidad de dígitos binarios que éste maneja. Por ejemplo, un conversor de 1 bit sería aquel que sólo clasifica amplitudes en dos (21) categorías: 0 (Apagado, No, Falso) y 1 (Encendido, Si, Verdadero), un conversor de 2 bits tendría cuatro (22) categorías, etc. Así, un conversor de n bits divide la escala de amplitud en 2n segmentos.

El audio digital tiene una resolución de 16 bits porque su escala de amplitud admite 65536 valores posibles y la TV digital procesa en 8 bits por lo que distingue 256 niveles de cada color primario.

En resumen, la digitalización es un proceso fundamental para el intercambio de información entre los sistemas informáticos y la naturaleza y está presente en la mayoría de las actividades humanas modernas. Los términos expuestos en este artículo son fundamentales para comprender como se utiliza la tecnología actual, tanto en actividades recreativas como el cine o la música, como en la investigación científica o la transferencia de datos bancarios.

Debug data: